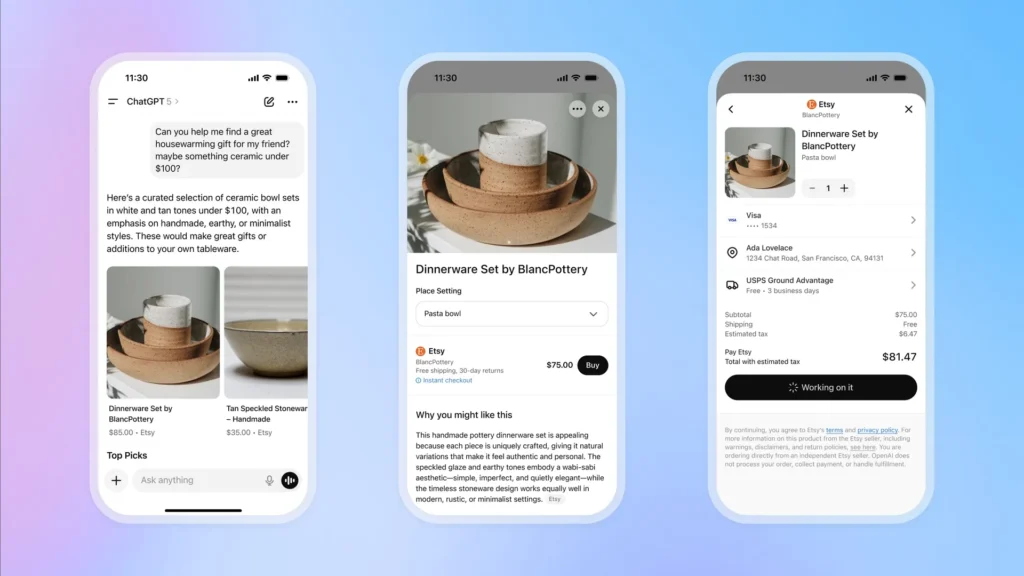

"ChatGPT kullanımıyla ilgili önemli bir güncelleme geldi. Artık bu yapay zekâ modelinden sağlık, hukuk ve finans alanlarında doğrudan danışmanlık alınamayacak."

Yapay zekâ kullanıcılarının dikkat etmesi gereken büyük bir değişim yaşanıyor:

ChatGPT artık “danışman” yerine eğitim aracı olarak konumlandırıldı. Bu değişim, kullanıcıların ilaç dozajı alma, dava dilekçesi hazırlama veya yatırım önerisi alma gibi eylemlerde ChatGPT’ye başvurmasını engellemeyi amaçlıyor.

Yeni kurallar arasında yer alan bazı kısıtlamalar:

İlaç ismi veya dozaj verilemez.

Dava dilekçesi hazırlanamaz.

Yatırım tavsiyesi yapılamaz.

Yapılan açıklamalarda, bu adımın sebebi olarak yapay zekânın yanlış yönlendirme riski, profesyonel uzmanlık gerektiren alanlarda halkın güvenliğinin ön planda tutulması ve teknolojik sorumlulukların netleştirilmesi gösteriliyor.

Şirketlerin ve regülatörlerin bu yönde aldıkları kararlar, ‘yapay zekâ-etik’ ve ‘yapay zekâ-hukuk’ ekseninde tartışılan meseleleri somut uygulamalara dönüştürüyor.

Neden Önemli?

Kullanıcılar açısından: ChatGPT kullanıcıları artık sağlık, hukuk, finans gibi kritik kararlar için büyük bir uyarı ile karşı karşıya. Bu alanlarda yapılacak başvurular için gerçek uzmanlarla iletişim şart.

Teknoloji ve regülasyon açısından: Yapay zekânın rolü, sınırları ve sorumlulukları yeniden tanımlanıyor. Buna göre, yapay zekâ “yardımcı” bir araç olarak kullanılmalı, uzmanlık gerektiren hizmetlerin yerini almamalı.

Sosyal ve etik açıdan: Bu gelişme, “yapay zekâ ne kadar yetenekli olursa olsun, insan uzmanlığının yerine geçemez” tezini destekliyor ve kullanıcı güvenliği için önemli bir adım olarak değerlendiriliyor.

Kaynak: Diken

#samedya #ChatGPT #YapayZeka #SağlıkDanışmanlığı #HukukDanışmanlığı #FinansDanışmanlığı #TeknolojiRegülasyonu #YZetik